andisendi.blogspot.com 神奈川県内で学習塾を展開する「STEP(ステップ)」が「イード・アワード2021 塾」において、3年連続で「中学生/集団指導の部」の最優秀賞を獲得した。ステップ代表取締役社長の遠藤陽介氏に、多くの生徒や保護者にステップが支持される理由や神奈川県内の公立難関校を中心に合格実績でトップを走る背景等を聞いた。

3年連続で最優秀賞を獲得

--2019年、2020年に続き、3年連続で中学生・集団指導の部の「最優秀賞」 を獲得されました。また部門賞で「面倒見の良い塾」「講師が良い塾」「教材が良い塾」「成績が上がる塾」「授業がわかりやすい塾」「子供が好きな塾」「受験・進学情報充実の塾」を受賞され、高校生・大学受験生の部では「面倒見の良い塾」「子供が好きな塾」の部門賞を受賞しています。ご感想を教えてください。

今回3年連続の最優秀賞とともに多くの部門賞を獲得できたのは大変うれしい限りです。私たちステップの教師たちは賞をいただくことを目的として授業をしているわけではありませんが、こうして社会的に認知されているイード・アワードという賞をいただけることは大変ありがたいと思います。教師たちにとっても「成績が上がる塾」や「面倒見が良い塾」という項目でナンバーワンを獲得できたのは、とても励みになると思います。

コロナ禍を通じて対面授業の良さを実感

--2019年度の受賞時にインタビュー させていただいてからコロナ禍も本格的に広がりました。日々の学習や部活等の行事も制限がある中でどのような対応をされてきましたか。

2年前の3月には全国の小中高が休校になり始め、e-STEPという欠席や復習のために用意していた動画コンテンツの視聴を呼びかけ2週間私たちの塾もすべて休校にしました。ただ、生徒たちからしてみれば普段とは違う教師が授業をするものだったので、この時のe-STEPの視聴率はあまり芳しいものではなく、これでは正規の授業料をいただくわけにはいかないと考え、在籍料を除く9割の授業料をお返しいたしました。コロナ禍で生徒や保護者のみなさんが苦しむ中にあって、ステップだけが授業料を満額いただくというわけにはいかないという思いもありました。

春期講習はかろうじて実施することができましたが、その後、4月から緊急事態宣言発令に伴い、再び学校が一斉休校になり、今度は授業料の60~80%をカットする特別授業料としました。その時は3月の反省を踏まえて、各校舎の各クラス、各科目の担当教師が授業の動画を配信。普段の授業を担当する教師が動画を配信するので、生徒も視聴するようになった んです。それをステップの小中学部全校舎、英数国理社の5科目で実施し、その数はおよそ4万本以上におよびました。また、その間も毎朝Zoomでホームルームを行い、コミュニケーションを取り、小中学校に通えない生徒たちに寄り添う対応をしました。

--まさに学校ですね。

生徒たちは当時、学校も部活も修学旅行にも行けないという、とてもつらい時期でしたが、毎朝Zoom越しにみんなで顔を合わせることができて、生活リズムを保てたんですよね。保護者もお仕事が休みや在宅勤務になり、ステップの教師はこういう授業をしているんだ、こうやって子供たちに接しているんだと、授業を知ってもらえる良い機会になったと思います。

始めは不慣れだったオンライン授業も、徐々に教師たちも慣れていき、Zoomを使って対面でライブの授業をやろうという動きが広がり、ライブ授業を行うことにしました。動画の配信に加え、このライブ授業もとても好評で、緊急事態宣言が明けると、かつてないほど生徒や保護者の方から感謝の声をいただきました。

「Zoomによるホームルームで先生や友達の顔が見ることができて本当に感謝しています」「行動の早さが素晴らしかったです」「朝のホームルームで家庭学習のベースができたのが良かったです」「普段、教えてくださっている先生方で子供も親しみを持って真剣に見ていました」「家庭学習は孤独を感じやすいですが、Zoomのホームルームは1日15分でも毎日クラスの友達のようすがわかって、子供も良い刺激をもらったようです」といった声をたくさんいただきました。

今の時期、また新型コロナウイルス感染症の感染状況が厳しくなってきましたので、昨日(インタビューは2022年1月28日に実施)から、小学5年生から中学2年生までをZoomによるオンライン授業中心に切り替えました。ただ中学3年生だけは公立高校入試が2月15日に迫っていますので対面をベースに、Zoomでの参加もOKとしていますが、多くの受験生は対面を選択しています。Zoomは対面授業に参加できない際の代替ツールとしては充分機能しますが、学習効率は対面授業の方が良いと思います。生徒の答案を見て、ここはこうやって間違ってるねといったやりとりまではZoomではなかなか難しい。生徒たちもこのコロナ禍を経験したからこそ、逆に対面授業の良さに気付いた のかと思います。

授業の質・神奈川特化・合格実績という3つの強み

--2021年の高校受験実績を振り返ると、湘南、横浜翠嵐、厚木、柏陽、厚木等の難関校における合格実績は全塾の中でもNo.1をキープされています。中学生の受験指導での特徴やこだわりを教えてください。

私たちの強みやこだわりで最初に挙げられるのは「授業の質 」です。ステップでは教室長やブロック長、本部長、経営陣、社長も、役職が上がっても継続して授業を担当 します。65歳を過ぎても今もなお日々授業を担当している教師もいます。

学習塾はバイト感覚で学生がする仕事と考えていらっしゃる方もいるかもしれませんが、私たちは一部、外国人講師の方等を除けば、96%が正社員である専任教師のプロ集団 です。「いい授業をすることこそが最大の営業」というポリシーの元、教師が営業活動をすることもありません。

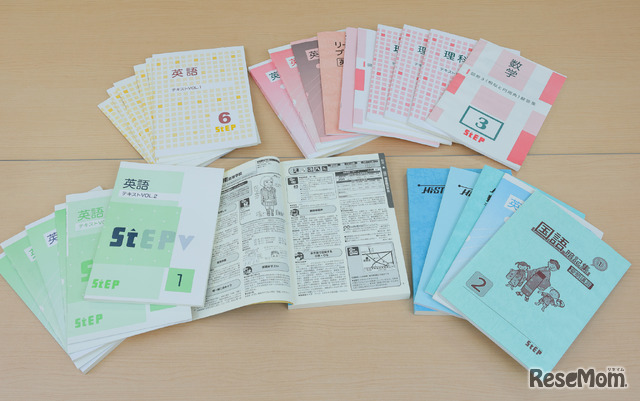

教材研究にも力をいれており、教材研究部という部署で社員の専門性を生かしてオリジナルの教材を制作 しています。たとえば、神奈川県公立入試のひとつ、「特色検査」を専門に研究チームがあり、特色検査模試をはじめ、専門教材の作成を行っています。充実した時間割や研修、教材制作をはじめとして、正社員化は圧倒的なメリットがあります。

「授業の質」にこだわり、教材研究部が制作しているオリジナル教材

次に考えられるのは、やはり「

神奈川県に特化 」していることでしょう。よく他県への進出について聞かれますが、これからも神奈川を出ることは考えていません。最近では昔の生徒が現在のステップ生の保護者という、親子二代ステップ生も珍しくありません。

ステップは教師の力を大切にしているため、教室を増やすにも「ゆっくり急ぐ」ことをポリシーとしています。こうした長年の積み重ねが地域での信頼感につながっているとも感じています。

最後はもちろん、神奈川県で翠嵐、湘南、厚木、柏陽、川和といった学力向上進学重点校をはじめ、県内の公立トップ校、横浜市内の公立トップ校の合格実績でナンバーワン であることです。私たちの進路指導のスタンスは、生徒、ご家庭が決めた進路を全力で応援することですが、その結果が、翠嵐や湘南などの学力指導重点校での合格実績ナンバーワンにつながっていると思います。

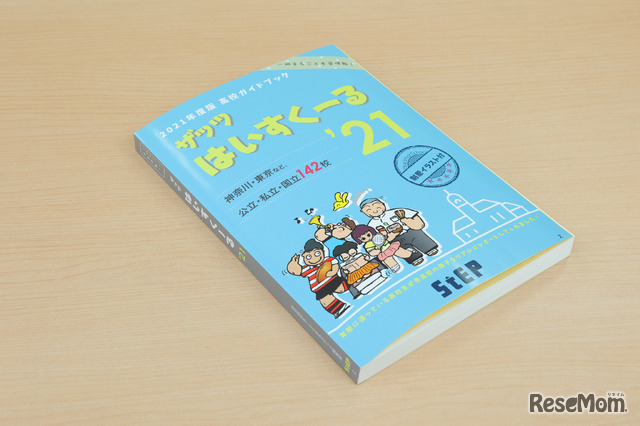

オリジナルの高校ガイドブックは、合格したステップ生OB・OGのイラストやコメントがびっしり

--部活動との両立も特徴とされていますね。

中学生も高校生もほとんどの生徒が部活をやりながらステップに来ています。神奈川県は部活も盛んで、部活と両立し、日々忙しい中ドロドロになったままステップに来て、「宿題を忘れました」という生徒もいます(笑)。もちろん宿題はやってきたほうが良いけれど、「そういうこともあるよね、一緒に頑張っていこう!」と温かく接しています。

--生徒の先生の距離が近いのでしょうか。

それはあると思います。ステップの教師たちは、フレンドリーで近所にいるよい兄貴やお姉さんという存在です。とはいえ規律は保たれていて、あるときはチームのキャプテンのようにリーダーシップを発揮するなど、教師がただの友達になってしまわないよう、適度な距離感を保ちながらサポートしています。

変化していく教育に柔軟に対応

--新学習指導要領の全面実施で、英語4技能強化、科目横断型の学びや探究学習など中学生の学びにも変化がありました。評価観点も「知識・技能」「思考・判断・表現」「主体的に学習に取り組む態度」の3観点に変わりました。生徒や保護者からの相談事はありましたか。

地域や学校によっても異なる場合はありますが、観点別評価が4項目から3項目に変わり「5」が取りにくくなっています。「5」の数は減り、「4」と「3」に集中しているようです。逆に「2」も少し減ったようです。

また英語に関しては、以前の学習指導要領では中学3年間で習う単語数は1,200語でしたが、新指導要領では小中学校合わせて2,500語。小学校のうちに600~700語を学んでいる前提です。ところが中学校では、小学校では学習していないと判断して今までどおりにアルファベットから教える先生もいれば、小学校ですでに学習していることを前提として授業を進める先生もいらっしゃいます。現場は混乱しています。保護者の方からは、「本当に大丈夫なんでしょうか」という不安の声をよく聞きます。

私たちは英語を受講していない生徒にも、小学6年生ではこのぐらいを知っておくと良いですよと単語リストを用意して、一般動詞とbe動詞の違いを見分けられる練習やローマ字を読めて書けるようにガイドしています。中学校によって対応はさまざまですが、ステップに来れば、最終的に入試までに力を付けていく ので、心配しないで来てくださいと呼びかけています。

また、最近ステップでは、英語が得意ならば、小学6年生で4級を、中学2年生で準2級、中学3年生で2級を取得という目標設定をお勧め しています。最近では英検2級にチャレンジしようという中学生がだいぶ増えてきました。

そしてステップならではの「はば広教養」という科目横断的な勉強 を、小学生から中学生の授業で実施しています。これがとても人気です。内容としては、社会的なこともやるし、国語的なこともやるし、理科的なこともやって雑学を広げる、まさに科目横断です。こうした取組みも思考力重視の特色検査に強くなる要素 のひとつになります。

「科目横断的な独自の授業『はば広教養』は特色検査に強くなる要素のひとつ」と語る遠藤社長

また「はば広クイズ王決定戦」と題して、教室で予選会からスタートして地区予選から本選に進む大会を開催しています。教室ではステップが無線で飛ぶ早押し機を作り、生徒1人1台ずつ用意。予選はZoomで開催ですが、今年はコロナで本選決勝もZoomになるかもしれません。実は昨年もとある有名テレビ番組に横浜翠嵐高校のクイズ研究会が出場しましたが、出場者3人全員がステップ生でした。いつかテレビのクイズ番組はステップ生が独占という日を夢見ています(笑)。

楽しく力を付ける

--入塾のタイミングや目的について傾向があれば教えてください。

小学5年生や6年生から通う方、この学習指導要領が変わったことでやはり英語が心配という方は増えました。ステップ全校舎で満席の教室が増えていますが、中学3年生は入試前11月になると募集はストップします。私たちはずっと応援してきた生徒を最後はしっかりサポートしたいので、11月以降は新規入会をお受けしていません。

最近は中学2年生でも満席で空席待ちが出ていますので、中学2年生で入れないから中学1年生、中学1年生でも満席なので小学5、6年生からと、徐々に入会時の年齢が下がってきています。またステップでは、小学6年生の12月までに小学6年生の内容を終えて、1月からは中学数学「正負の数」を始めますので、そのタイミングでの入塾希望も多いです。

--今後の展望を教えてください。

神奈川県内に強力なネットワーク体制を作っていきたいと考えています。今年は新たに武蔵新城、武蔵中原、向ヶ丘遊園の3スクールを開校しました。現在、藤沢市の中学生の4人に1人、海老名市も5人に1人がステップ生なのですが、まだそれほど開校していない川崎市や横浜市を中心に今後、拡大していきたいです。

--入塾を検討中の保護者にメッセージをお願いします。

ステップの教師たちの人柄から生まれる、「楽しく力の付く授業 」を、ぜひ一度、体験してほしいと思います。「はば広教養」の体験授業は本当に盛り上がります。保護者会でやってみても、保護者の方が熱中されますので(笑)。

--勉強が苦手で保護者に連れて来られるお子さまも、体験授業で変わる場合はありますか。

来る時は乗り気ではなかったけれども、帰る頃にはもう一度やってみたいとなるお子さんは多くいます。体験に来てもらうとステップの良さをわかっていただけると思います。

--ありがとうございました。

小学生、中学生のみならず、高校生・大学受験生向けのスクール「大学受験STEP」も現在、多くのクラスが満席の状態だという。さらに小学1から4年生対象のアフタースクール「STEPキッズ」では、サイエンスやプログラミング、卓球、ボルダリング、手話、百人一首、将棋、ダンス、いも掘り等、子供たちの豊かな体験や興味喚起を促す充実した独自プログラムを藤沢・茅ヶ崎・辻堂の3教室で展開中で、人気が高まっているそうだ。

遠藤社長は現在も、たまプラーザスクールの中学部で英語の授業を受けもち、翠嵐特訓講座でも英語を教えている。数字を交えた説得力のある話ぶりは快活そのもので、インタビューが進むにつれて、こちらが元気になってきた。神奈川を地盤にしたステップへの支持は、さらに地元の子供たちや保護者に広がることだろう。

Adblock test (Why?)

からの記事と詳細 ( 専任の教師だから実現できる「STEP」の楽しく力の付く授業 - リセマム )

https://ift.tt/nzEQCqx